マルチOC作成ガイド:AIアニメ動画でキャラクターの一貫性を保つ方法

はじめに

複数のオリジナルキャラクター(OC)が登場するアニメ動画の作成は、AI創作における最も困難なタスクの一つです。多くのツールでは、数秒経つとキャラクター同士が混ざり合ったり、衣装の細部が失われたり、設定した外見からかけ離れてしまったりすることがよくあります。

AnividAIは、これまでのツールとは設計思想が異なります。保存されたOCがワークフローの基盤となっているため、シーンごとにリファレンス画像をアップロードし直したり、外見のプロンプトを何度も書き直したりする必要はありません。ライブラリから直接OCを選択するだけで制作を始められます。

本ガイドでは、AnividAIで現在推奨される「マルチOC動画作成」の最適ワークフローと、近日公開予定の「Kling-o1ネイティブOCパイプライン」のプレビューについて詳しく解説します。

ワークフロー1:リファレンス優先メソッド(現在利用可能)

構図、キャラクターの配置、視覚的な一貫性を強力にコントロールしたい場合に、現在最も信頼できる方法です。考え方はシンプルです。まず高品質な「キーフレーム(静止画)」を作成し、その画像を動画生成のアンカーとして使用します。

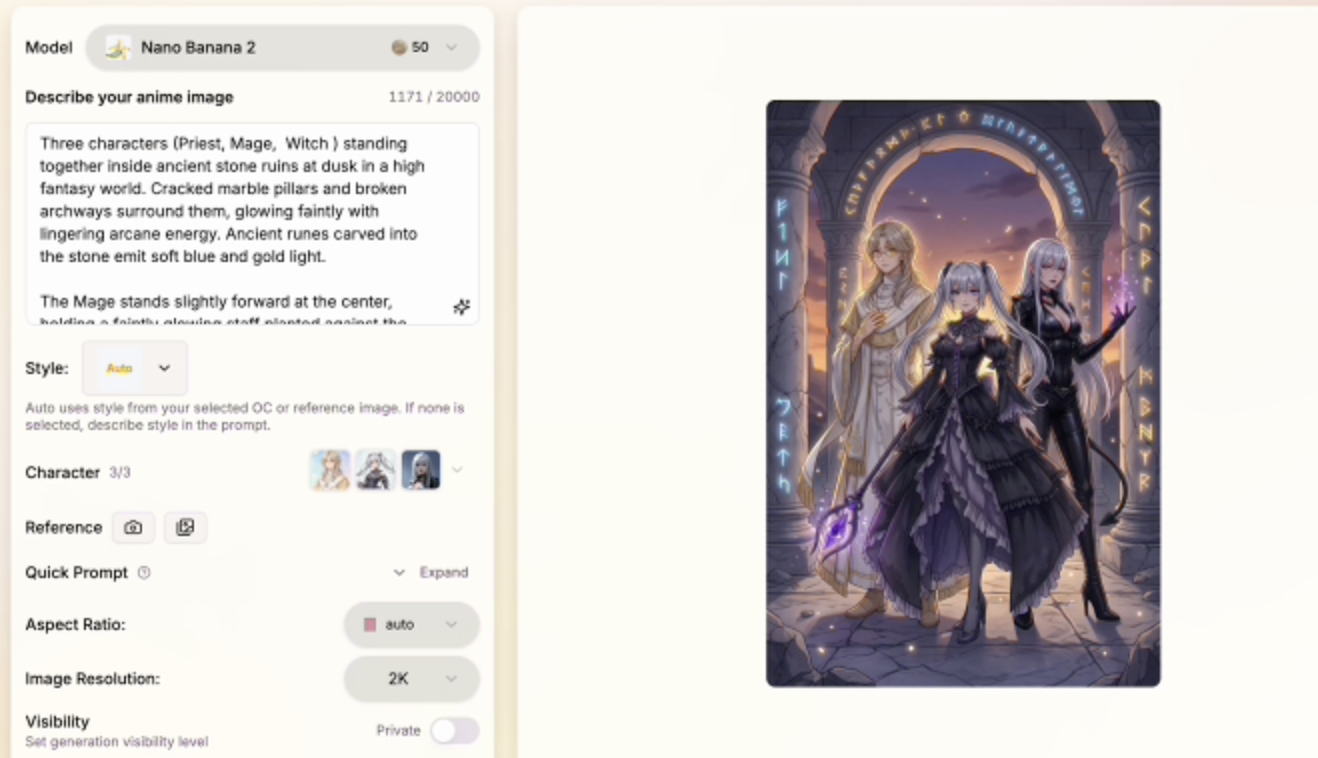

ステップ1:複数のOCを選択してキーフレームを生成する

Anime Generator を開き、キャラクターピッカーから保存済みのキャラクターを選択します。

- 直接OC選択: キャラクターの詳細な説明を再度手入力する必要はありません。

- サブスクリプション特典: 有料プランをご利用の方は、最大 3つのOC を同時に選択できます。

- プロンプトのポイント: シーン、アクション、ムード(雰囲気)のみを記述します。

プロンプト例:

雨の中で一本の傘を共有しているキャラクターAとキャラクターB、映画のようなライティング、4k

AnividAIは、選択されたOCプロファイルを視覚的なアンカーとして使用します。これにより、生成されたキーフレームにおいて、キャラクターのアイデンティティ、髪型、衣装、デザイン言語が正確に保持されます。

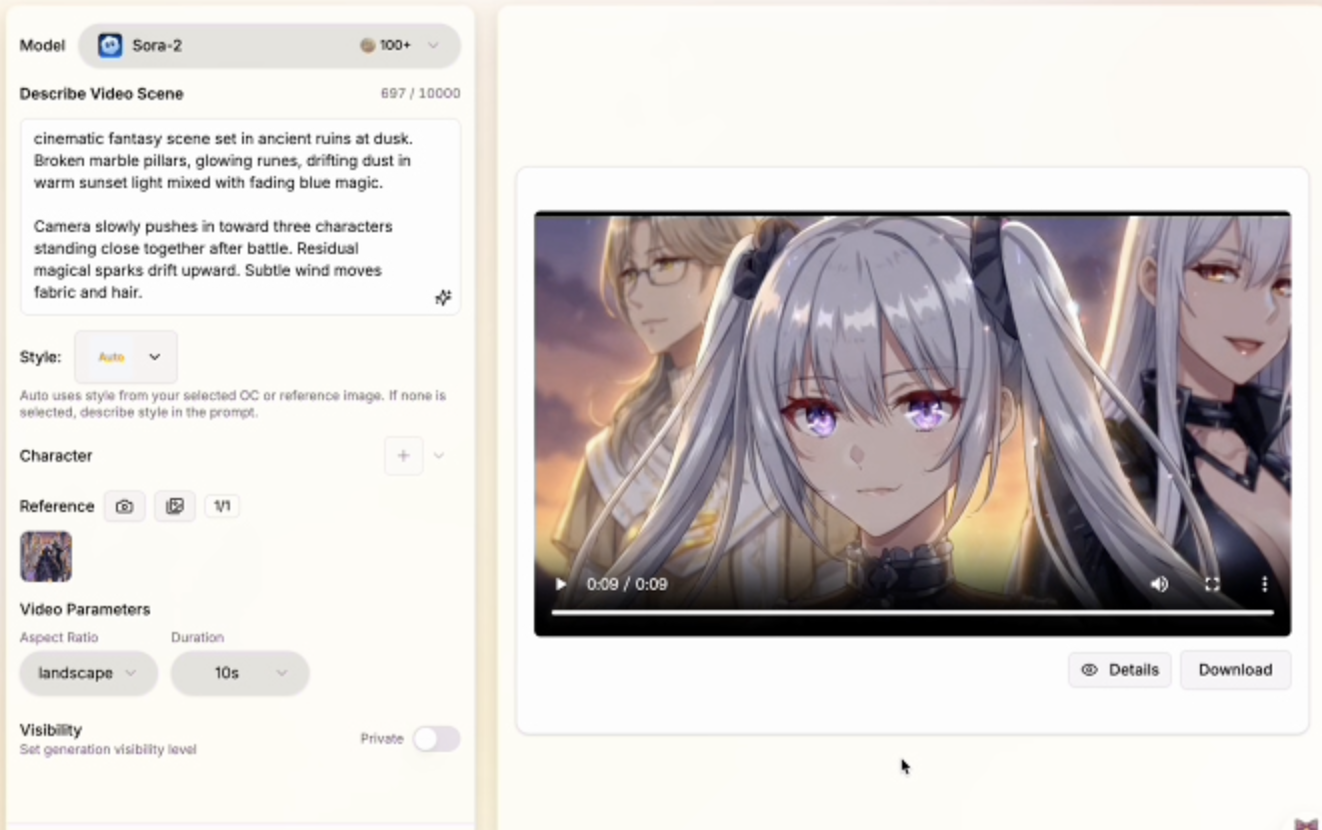

ステップ2:キーフレームを動画ワークフローに移行する

納得のいく画像が生成されたら、Anime Video Generator に切り替え、そのキーフレームを「リファレンス画像(参考画像)」として使用します。

- リファレンス画像: 生成したキーフレームがメインの視覚的設計図になります。

- モデルの選択: Kling 3.0 や Veo 3.1 など、互換性のある動画モデルを選択してください。

- モーションプロンプト: 動き、カメラワーク、感情的なペースに集中して記述します。

モーションプロンプト例:

キャラクターたちが雨の中をゆっくりと歩き、お互いを見つめ合う。緩やかなカメラズーム。

このワークフローが特に有効なのは、動画モデルが「正しいキャラクターが正しい関係性で配置された画像」からスタートするため、アニメーション中のアイデンティティの崩れ(ブレ)が大幅に軽減されるからです。

ステップ3:始点と終点のフレームを指定してさらに制御する

より緻密な動きの制御が必要な場合は、同じOCを選択した状態で2つの画像を生成し、それらを「最初のフレーム(First Frame)」と「最後のフレーム(Last Frame)」として使用します。

これにより、以下のような表現が可能になります:

- 2つの構図間でのカメラ移動

- キャラクターのアイデンティティを保ったままのポーズ変更

- より意図的で短いナラティブ(物語的)なカット

例えば、最初のフレームで「傘の下に立っている二人」を表示し、最後のフレームで「一緒に前へ歩き出す二人」を表示することで、AIモデルに対して明確な動きの軌道を示すことができます。

ステップ・バイ・ステップ:全プロセスデモ

ワークフロー2:Kling-o1 ネイティブOC統合(近日公開)

AnividAIは現在、プラットフォームのキャラクターシステムとより直接的に連携する Kling-o1 を中心とした、より深いワークフローの準備を進めています。

Kling-o1では、リファレンス画像に依存するだけでなく、Character Studio に保存されている視覚情報を直接読み取ることで、より「アイデンティティを認識した(Identity-aware)」生成が可能になる予定です。

1. 視覚的アイデンティティの直接注入

Kling-o1で複数のOCを選択して生成する際、システムは各キャラクターの保存されたビジュアルプロファイルを内部的なアイデンティティのアンカーとして使用できるようになります。

つまり、モデルは以下のようなテキスト情報だけに頼る必要がなくなります。

青髪の女の子、ピンク髪の女の子、学校の制服

その代わりに、それらの説明の背後にある、実際に保存された「OCのアイデンティティ」を参照できるようになります。

2. キャラクターの分離精度の向上

AI動画における最大の課題の一つは、キャラクター同士が融合してしまうのを防ぐことです。Kling-o1は、選択された複数のOC間の区別をより正確に保持するように設計されており、各キャラクターが個別の顔立ち、色彩、衣装、役割の明確さをショット全体で維持できるようになります。

3. リファレンス設定の手間の削減

この新しいワークフローの目標は、画像から動画へのセットアップを繰り返す手間を減らすことです。Character Studio でキャラクターが詳細に定義されていれば、動画インターフェースでそれらを直接選択するだけで、より迅速かつ安定したクリエイティブプロセスが可能になります。

マルチOC生成を成功させるためのベストプラクティス

どのワークフローを使用する場合でも、OCのセットアップの質が結果を左右します。結果を最大化するためのヒントをいくつか紹介します:

- まずキャラクターを完成させる: 複数キャラクターのシーンで使用する前に、Character Studio で各OCの外見(ルック)を明確かつ安定させておきましょう。

- 視覚的な特徴を際立たせる: シルエット、髪色、アクセサリー、衣装のデザインに明確な違いを持たせることで、AIがキャラクターを識別しやすくなります。

- 外見ではなくシーンを記述する: キャラクターを選択済みであれば、プロンプトの「文字数制限」は構図、アクション、ムード、カメラの演出に使いましょう。

- 強力な静止画から始める: キーフレームが正しく生成されていれば、動画生成でもモデルが崩れにくくなります。

- 短くクリーンなモーションプロンプト: 特にマルチキャラクターのショットでは、複雑すぎる指示よりも、シンプルで明確な動きの指示の方が良い結果を生むことが多いです。

結論

ストーリー、デュオ、ライバル関係、あるいはグループのダイナミクスを描きたいクリエイターにとって、マルチOCの一貫性は「単なるランダムなクリップ」と「信憑性のあるアニメーションシーン」を分ける決定的な要素です。

現在、AnividAIで最も効果的な道は「リファレンス優先」ワークフローです。保存したOCを選択し、クリーンなキーフレームを生成してから、好みの動画モデルでアニメーション化しましょう。プラットフォームの進化に伴い、登場予定の Kling-o1 統合によって、直接的なマルチOC動画制作はさらにシームレスなものになるでしょう。

固定キャラクターが登場する、より安定したアニメーション・ストーリーテリングを目指すなら、まずはこのワークフローをマスターしましょう。

続きを読む

キャラクタースタジオ:あなたのAIアニメ・ユニバースの核となるもの

キャラクタースタジオ(旧 OC Maker)で、あなたの創造性を解き放ちましょう。視覚的なデザインから性格、スキルまで、AIを使って一貫性のあるオリジナルキャラクター(OC)を作成できます。既存のキャラクターを無料でインポートし、イラストやビデオ生成のアンカーとして活用する方法を学びましょう。

続きを読む

OC(オリジナルキャラクター)とは?アニメファンのための完全ガイド

OC(オリジナルキャラクター)とは?その意味や種類、作り方をアニメファン向けに徹底解説!「オリキャラ」や「夢主」の違い、絵が描けなくてもAI(AnividAI)を使って簡単に理想のキャラクターを作る方法まで、初心者にも分かりやすく紹介します。創作活動を始めたい方必見のガイドです。

続きを読む